Intelligenza artificiale e cyber security

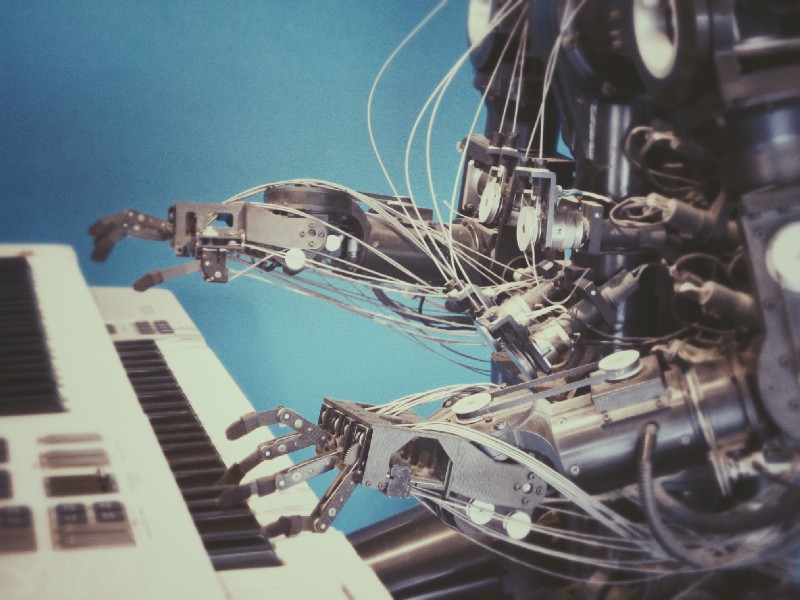

Anche se l’intervento umano è ancora considerato essenziale nel settore l’intelligenza artificiale (IA) è oggi in prima linea nella battaglia della cyber security per salvare le organizzazioni dagli hacker. Sebbene l’intelligenza artificiale abbia compiuto progressi significativi nelle sue applicazioni in tutti i settori, al momento il suo utilizzo nella sicurezza informatica può ancora essere definito come “nascente”.

L’IA – che parte dll’emulazione del pensiero umano – infatti aiuta ad esempio i professionisti e gli esperti nell’analisi del riconoscimento vocale e comprendere in modo accurato il crimine informatico in un momento in cui le aziende e le organizzaziini – esposte alle crescenti minacce – richiedono tecnologie di sicurezza elevate.

L’IA sta dicentando anche un potente strumento nel campo della protezione dei dati e contro attacchi potenzialemnte articolati, derivanti dallo sviluppo della tecnologia 5G e dell’Internet of Things che si stima porteranno ad attacchi informatici di quinta generazione– multi-dimensionali, multi-stadio, multi-vettore, polimorfici – e su larga scala che richiedono una prevenzione in tempo reale e continui aggiornamenti per evitare attacchi zeroda, oltre all’utilizzo di Firewall con funzioni avanzate di nuova generazione (NGFW).

Ma cosa è un attacco di Quinta Generazione? Un attacco cibernetico estremanente pericoloso e a grande scala, progettato per infettare più componenti di un’infrastruttura informatica, comprese le reti, le macchine virtuali istanze cloud e i dispositivi endpoint. Un attacco di questo tipo è in grado di superare le barriere di difesa dei FireWall: primi esempi di questo tipo di tacchi sono stati NotPetya e WannaCry.

Andrea Biraghi

Intelligenza artificiale e cyber security: benefici e rischi

In tutto questo non bisogna dimenticare che l’intelligenza artificiale può rappresentare un arma a doppio taglio: si necessita quindi mettere in conto che l’IA stessa possa essere violata la pari di ogni sistema e quindi rappresentare una perdita piuttosto che un benficio. Tra le tecnologie che devono investire in una solida sicurezza dell’IA la guida autonoma, i missili autonomi, telecamere di sicurezza e via dicendo.

Tra gli attacchi contro l’IA: l’alterazione dell’input dell’algoritmo (con inupt errati), informazioni false inserite nei data set che influiscono sui processi di data mining e attacchi alla privacy, dove in fase di addestramento l’IA può venire sfruttata per raccogliere informazioni sul suo algortimo.

I benefici e i vantaggi tuttavia sono numerosi, tra cui una maggiore efficienza e accuratezza degli analisti informatici, con una riduzione notevole del tempo di analisi e dei costi di rilevamento. Consente inoltre una risposta più veloce e quidni efficace alle violazioni, automatizzando le contromisure. Tra i benefici anche la possibilità di migliorare le analisi predittive e la mitigazione dei rischi.